1.OpenStack Neutron简介

Neutron添加了一层虚拟的网络服务让租户(用户)构建自己的虚拟网络。Neutron是对网络的虚拟化,该网络可以从一个地方移动到另一个地方,而不会影响现有的连接。它可以进一步解释为一个网络管理服务,为创建和管理虚拟网络公开了一组可扩展的API(通过创建虚拟网络为OpenStack Compute节点上的虚拟机提供网络服务)。Neutron的插件架构为开源社区或第三方服务提供API。Neutron还允许供应商研究和添加新的插件,提供先进的网络功能。

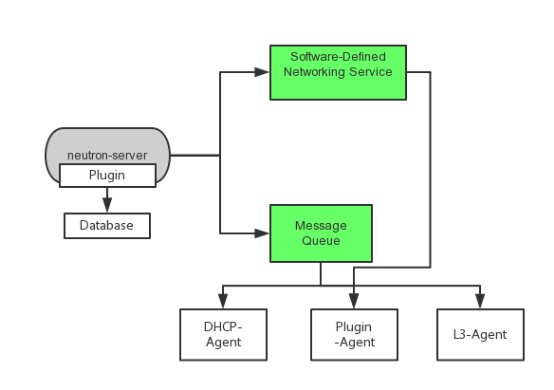

目前,Neutron的虚拟网络服务没有传统网络成熟。下图描述了与Neutron组件交互的代理。组成Neutron的元素如下:

Neutron-server是python虚拟光驱, 是OpenStack网络运行在Network节点的主过程。

Plugin agents和Neutron插件一起管理虚拟交换机,Plugin agents依赖Neutron插件。

DHCP agent是Neutron的一部分,为租户的网络提供DHCP服务。

L3 agent负责层3和NAT转发来获得租户虚拟机的外部访问。

SDN对于neutron的意义在哪里?

引入SDN主要是克服Neutron的缺陷,SDN是一种网络技术,通过集中的可编程控制平面来管理整个数据平面。这样网络运营商和供应商可以控制和管理自己的虚拟化资源和网络。SDN是一种新型的网络模式,允许硬件和操作系统之间以及物理/虚拟网元和操作系统之间通过开放API通信。

2.SDN控制器跟neutron结合原理

(1)Neutron Server的介绍

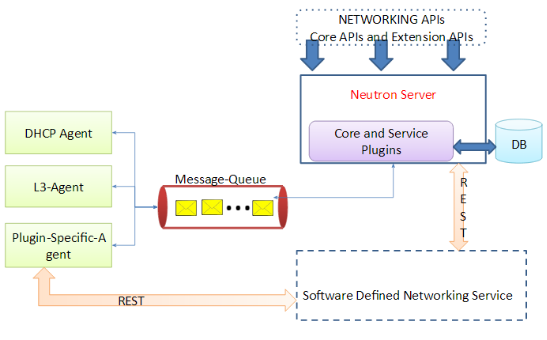

A python daemon is the main process of the OpenStack networking that typically runs on the controller node (a term used in OpenStack deployments). It exposes APIs, to enforce the network model, and passes the requests to the neutron plugin.

意思就是暴露API,使得请求能够被传到plugin中。

(2)Plugins的介绍

Plugins can be either core or service. Core plugins implement the “core” Neutron API — L2 networking and IP address management. Service plugins provide “additional” services, such as the L3 router, load balancing, VPN, firewall and metering. These network services can also be provided by the core plugins by realizing the relevant API extensions. In short, plugins run on the controller node and implement the networking APIs, which interact with the Neutron server, database and agents.

Plugin分为core和additional,用来处理neutron server传过来的请求。

下图是更为详细的neutron server如何传送给plugin消息的:

(3)Plugin Agents介绍

These agents are specific to the Neutron plugin being used. They run on compute nodes and communicate with the Neutron plugin to manage virtual switches. These agents are optional in many deployments and perform local virtual switch configurations on each hypervisor.

Agent跑在compute节点之上,与neutron的plugin进行通信

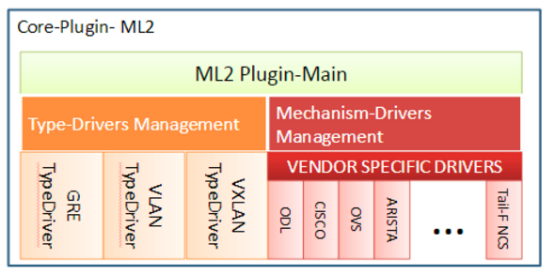

ML2 的plugin都是属于core。分为type和mechanism两种。Type drivers (如flat, VLAN, GRE 和VXLAN) 定义 L2 type。 mechanism drivers (如OVS, adrivers from ODL, Cisco, NEC, etc) 负责一系列动作(更新、创建、删除)网络、子网、端口。

整个过程可以分为下面几个步骤:

1.用户通过OpenStack的界面(horizon)输入消息给networking API,再发送给Neutron server

2.Neutron server接受信息发送给plugin

3.Neutron server/plugin 更新DB

4.Plugin通过REST API发送消息给SDN控制器

5.SDN控制器接受消息然后通过南向的plugins/protocols, 如OpenFlow, OVSDB or OF-Config.

3.ml2驱动脚本实现

下面是ml2驱动脚本“mechanism_gnflush.py”用于设置计算节点和网络节点与数据中心SDN控制器对接的配置。主要是将openstack的信息传递给SDN控制器。

|

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 29 30 31 32 33 34 35 36 37 38 39 40 41 42 43 44 45 46 47 48 49 50 51 52 53 54 55 56 57 |

ODL_NETWORK = 'network' ODL_NETWORKS = 'networks' ODL_SUBNET = 'subnet' ODL_SUBNETS = 'subnets' ODL_PORT = 'port' ODL_PORTS = 'ports' #下面是创建、更新、删除、网络组件的代码 def create_network_postcommit(self, context): self.synchronize('create', ODL_NETWORKS, context) def update_network_postcommit(self, context): self.synchronize('update', ODL_NETWORKS, context) def delete_network_postcommit(self, context): self.synchronize('delete', ODL_NETWORKS, context) def create_subnet_postcommit(self, context): self.synchronize('create', ODL_SUBNETS, context) def update_subnet_postcommit(self, context): self.synchronize('update', ODL_SUBNETS, context) def delete_subnet_postcommit(self, context): self.synchronize('delete', ODL_SUBNETS, context) def create_port_postcommit(self, context): self.synchronize('create', ODL_PORTS, context) def update_port_postcommit(self, context): self.synchronize('update', ODL_PORTS, context) def delete_port_postcommit(self, context): self.synchronize('delete', ODL_PORTS, context) #下面是把端口绑定到子网的代码 def bind_port(self, context): LOG.debug(_("Attempting to bind port %(port)s on " "network %(network)s"), {'port': context.current['id'], 'network': context.network.current['id']}) for segment in context.network.network_segments: if self.check_segment(segment): context.set_binding(segment[api.ID], self.vif_type, self.vif_details, status=n_const.PORT_STATUS_ACTIVE) LOG.debug(_("Bound using segment: %s"), segment) return else: LOG.debug(_("Refusing to bind port for segment ID %(id)s, " "segment %(seg)s, phys net %(physnet)s, and " "network type %(nettype)s"), {'id': segment[api.ID], 'seg': segment[api.SEGMENTATION_ID], 'physnet': segment[api.PHYSICAL_NETWORK], 'nettype': segment[api.NETWORK_TYPE]}) |

Openstack计算节点和网络节点配置

实验环境为CentOS7+OpenStack Juno , SDN 控制器为DCFabric。

步骤一: 工具脚本获取

在“tools/openstack-tools”目录下有shell脚本“gnflush-controller.sh”和ml2驱动脚本“mechanism_gnflush.py”用于设置计算节点和网络节点与数据中心SDN控制器对接的配置。(mechanism_gnflush.py(根据openstack官网的ODL plugin更改),mechanism_gnflush.py会在附录提供)将“mechanism_gnflush.py”这个脚本拷贝到Openstack控制节点服务器上如下目录下:

|

1 |

/usr/lib/python2.7/site-packages/neutron/plugins/ml2/drivers/ |

将“gnflush-controller.sh”拷贝到服务器上任意目录后续使用。

步骤二:关闭相关服务

在所有Openstack计算节点和网络节点上服务器上执行如下命令(CentOS):

|

1 2 3 |

systemctl stop neutron-server systemctl stop neutron-openvswitch-agent systemctl disable neutron-openvswitch-agent |

步骤三:配置ml2 plugin

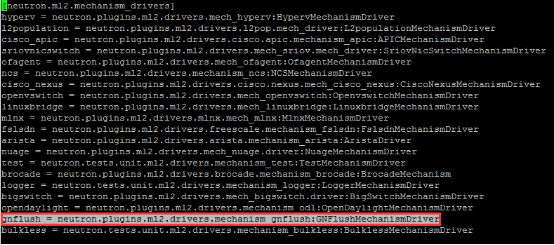

在数据中心文件“/usr/lib/python2.6/site-packages/neutron-2014.1.3-py2.6.egg-info/entry_points.txt”中“[neutron.ml2.mechanism_drivers]”配置节点下增加GNFlush控制器ML2 plugin的entry point:

|

1 |

gnflush = neutron.plugins.ml2.drivers.mechanism_gnflush:GNFlushMechanismDriver |

- 租户网络类型:管理员可以根据需要选择“gre”或者“vlan”。

- 控制器IP地址:数据中心SDN控制器所在服务器的IP地址。

- 控制器Rest服务端口:Rest服务监听端口需要查看SDN控制器配置文件中“[rest_port]”配置,默认为“8081”

在Openstack控制中心服务器上执行如下命令修改ml2配置,以租户网络类型为“gre”为例:

|

1 2 |

crudini --set /etc/neutron/plugins/ml2/ml2_conf.ini ml2 mechanism_drivers gnflush crudini --set /etc/neutron/plugins/ml2/ml2_conf.ini ml2 tenant_network_types vxlan |

在“/etc/neutron/plugins/ml2/ml2_conf.ini”文件最后面添加“ml2_gnflush”的选项:

|

1 2 3 4 |

[ml2_gnflush] password = admin username = admin url = http://192.168.53.3:8081/gn/neutron |

步骤五:配置Openvswitch

配置前,需要准备如下信息:

- 本地IP:当前服务器的IP地址。

- 网卡名称:用于建立隧道的物理网卡。

- 控制器IP地址:数据中心SDN控制器所在服务器的IP地址。

在所有Openstack计算节点和网络节点上服务器上执行如下命令,可以通过“--help”选项查看帮助信息:

|

1 |

sh gnflush-controller.sh --local_ip 192.168.53.52 --provider_mappings eth1 --gnflush_ip 192.168.53.3 |

步骤六:启动相关服务

执行如下命令启动服务:

|

1 |

systemctl start neutron-server |

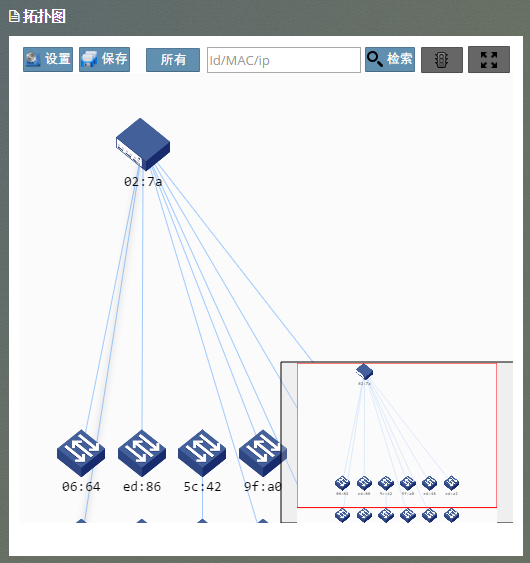

这个是自主开发的DCFabric的拓扑图。下图是已经连接OpenStack的Open vSwitch。

作者简介:

蒋暕青@上海宽带技术及应用工程研究中心:SDN技术实践者,大四北上思博伦实习半年,现工作地点上海